1. はじめに

自然言語処理(NLP)の進化は、このTransformerアーキテクチャの導入によって大きなターニングポイントを迎えました。

わかりやすい例としては、世間を現在進行形で賑わせているOpen AI社が生み出した「Chat GPT」などがあります。

このブログでは、Transformerの基本的なメカニズム、その発展形、そして多様な応用例について解説していきます。

2. Transformerの基本構造

2.1 アーキテクチャの概要

Transformerは、”Attention is All You Need”という論文で初めて提案されました。従来のリカレントニューラルネットワーク(RNN)や畳み込みニューラルネットワーク(CNN)を用いず、アテンションメカニズムのみに基づいて構築されています。

主な構成要素は以下の通りです:

- エンコーダー: 入力データを高次元空間にマッピングします。

- デコーダー: エンコーダーの出力を受け取り、ターゲットデータを生成します。

エンコーダーとデコーダーの各層は、多頭アテンションと位置ごとの全結合フィードフォワードネットワークから成り立っており、入力と出力の間で複雑な関係を学習します。

2.2 アテンションメカニズム

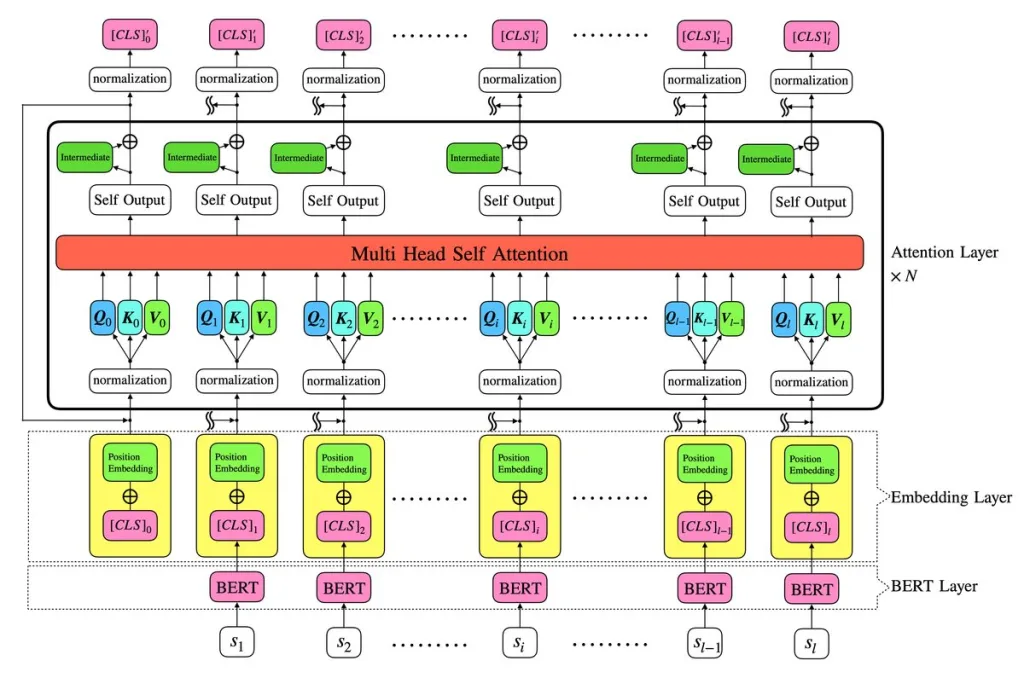

Transformerの核となるのは、セルフアテンションです。このメカニズムは入力の全要素が互いにどのように影響を与え合っているかを学習します。

そのメカニズム内でキー、クエリ、バリューの3つの要素を用いて情報の重要性を計算し、入力シーケンスのどの部分に注目すべきかをモデルに指示します。

このプロセスは、特定のタスクにおける情報の重要性をモデルが捉えることを可能にします。

これにより、モデルは入力シーケンス全体を一度に考慮することができ、効率的で効果的な学習が可能になります。

3. 進化するTransformer

3.1 BERTとその影響

BERT(Bidirectional Encoder Representations from Transformers)は、Transformerのエンコーダー構造を利用し、単語の埋め込みを生成する際に文脈を広範囲にわたって考慮します。

このアプローチにより、単語が現れる前後の文脈を同時に捉えることが可能となり、言語モデルの理解が格段に向上しました。

BERTは、特に細かい意味のニュアンスを捉える能力に優れ、自然言語理解(NLU)タスクに革命をもたらしました。

さらに、BERTの事前学習されたモデルは、多くの下流タスクでファインチューニングを行うことで、その有効性をさらに拡張しました。

BERTの双方向トレーニングのアプローチは、テキストの理解を根本から改善するものであり、多くの派生モデルの基盤となっています。

3.2 GPTシリーズ

OpenAIによるGenerative Pre-trained Transformer(GPT)は、細かな調整により特定のタスクに適応する能力を持っています。

それによって生まれたChat GPTは、その規模と汎用性により、さまざまな応用が可能になりました。

特に特にGPT-3は、その175億ものパラメータを駆使して、文章生成、要約、質問応答など、多岐にわたるNLPタスクにおいて卓越した性能を示しています。

GPT-3の強みは、事前学習によって獲得した広範な一般知識と文脈理解能力にあり、これにより、特定のデータセットに依存しない汎用的な応用が可能となっています。

4. Transformerの応用例

4.1 機械翻訳

Transformerモデルは機械翻訳の分野において、品質と効率の双方で革命をもたらしました。

その並列処理能力は、翻訳タスクにおける処理時間を大幅に短縮し、多言語間でのほぼリアルタイムな翻訳を実現しています。

また、文脈の全体的な理解を基に翻訳を行うため、より自然で正確な翻訳が可能となっています。

この進歩は、国際的なコミュニケーションや情報のアクセスの障壁を低減する助けとなっています。

4.2 コンテンツ生成

Transformerは、記事の自動生成、詩の創作、さらには音楽や画像の生成に至るまで、さまざまなクリエイティブな分野で応用されています。

特に、生成されたコンテンツが原文の文脈を理解し、適切なスタイルやトーンで応答する能力は、クリエイティブな産業において大きな可能性を秘めています。

このテクノロジーにより、コンテンツ制作者は新しいアイデアを得る手助けを受けながら、効率的に作業を進めることができます。

5. 結論

Transformer技術の進化は、AI研究において重要なマイルストーンとなっています。

その多様性と適応性により、未来のAI開発においてさらなるブレークスルーが期待されます。

また、これらの進展は、AIが人間の言語や創造性をどのように理解し、拡張するかの理解を深めることにも寄与しています。