転移学習は、人工知能(AI)と機械学習(ML)の分野において非常に重要な技術の一つです。この技術は、特定のタスクで学習した知識を別のタスクに適用することにより、学習過程を効率化し、データが少ない状況でも高いパフォーマンスを達成することを可能にします。

転移学習とは

転移学習は、ある問題領域で学習したモデルの一部または全体を、新たながら関連する問題に適用することです。主に、モデルが新しいタスクで必要とする知識の一部を、すでに学習済みのデータから抽出して利用します。このプロセスでは、ソースタスクとターゲットタスク間で知識が「転移」されることからこの名が付けられています。

転移学習とファインチューニングの違い

転移学習とファインチューニングは密接に関連していますが、異なるアプローチを持ちます。転移学習は、一般的にモデルの初期化や事前訓練されたネットワークの使用を指します。一方、ファインチューニングは、転移学習されたモデルに対して追加の訓練ステップを行い、ターゲットタスクにより密接に適合させるプロセスです。

数学的に説明すると、モデルMが与えられたとき、元のタスクで学習したパラメーθsを新しいタスクのパラメータθTへと適応させるプロセスを考えます。

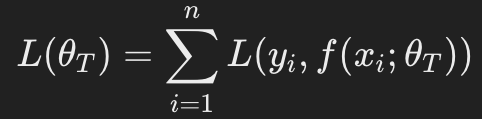

この適応は以下の損失関数を最小化することで行われます:

ここで、Lは損失関数、fはモデルの出力関数、(xi,yi)はターゲットタスクのデータポイントです。

転移学習が使われる例

- 画像認識:事前に大量の画像で訓練されたネットワークを、特定の物体認識タスクに転用します。

- 自然言語処理(NLP):一般的な言語モデルを基に、特定の言語タスク(例えば感情分析)にファインチューニングします。

- 医療画像分析:公開データセットで訓練されたモデルを使用して、新たな医療画像データセットの解析に応用します。

- 音声認識:一般的な音声データで学習したモデルを、特定のアクセントや言語の音声認識に適用します。

- 異常検出:さまざまなセンサーデータに基づく異常検出システムで、一般的なデータセットで訓練されたモデルを使用し、特定の環境下での異常を識別します。

まとめ

転移学習は、モデルの訓練時間の短縮とデータリソースの有効活用に寄与するため、AIの実用化において欠かせない技術です。特にデータが限られている場合において、転移学習は有効な手段となり得ます。

これにより、様々な分野での応用が期待される技術であり、私もタスクによって使用をしておりますが、今後の発展が楽しみです。